Am Anfang stand der Wunsch, mathematische Operationen fehlerfrei durchführen zu können. Die Veranschaulichung von Addition und Subtraktion durch einen Abakus hatte nicht nur in der Lehre Vorteile, sondern verringerte auch die Anzahl der Fehler und beschleunigte das Rechnen. Statt Rechenfehlern konnten Bedienfehler die Ergebnisse beeinträchtigen. Der Bediener konnte versehentlich die falsche Anzahl Kugeln verschieben, sich beim Abzählen der Kugeln irren oder durch Schusseligkeit Rechenfehler bewirken. Deshalb hat sich bis heute der Spruch gehalten, dass die größte Fehlerquelle vor dem Computer sitzt.

Der Beitrag bildet das zweite Kapitel im Buch „Der Apple-Faktor“. (bei amazon.defür 14,90 Euro bestellen)

Im Laufe der Jahrhunderte wurde das Hantieren mit den sogenannten arabischen Ziffern zum Standard, die uns geläufige schriftliche Addition war mit römischen Ziffern nicht möglich. So wurden Maschinen erdacht, die mit abstrakten Ziffern statt mit abzuzählenden Kugeln arbeiten. Die erste Rechenmaschine kann auf 1623 datiert werden. Leibniz’ Rechenmaschine soll nach jüngeren Erkenntnissen zuverlässig gearbeitet haben, wenn auch die Reparatur aufwändig war. Um 1900 stellten bereits mehrere Firmen Rechenmaschinen her. In der zweiten Hälfte des 20. Jahrhunderts lösten elektronische Rechenmaschinen die mechanischen ab.

| Gerät | Prinzip | Erfinder | |

|---|---|---|---|

| Antike | Abakus | räumliche Addition | |

| Antike | Rechenbrett | räumliches Rechnen | Pythagoras |

| 1. Jh. v.u.Z. | „Computer von Antikythera“ | ||

| 1623 | Rechenmaschine | Rechenstäbchen | Wilhelm Schickard |

| 1645 | Rechenmaschine | Zahnräder, Sperrklinken | Blaise Pascal |

| 1673 | Rechenmaschine | Staffelwalzen | Gottfried Wilhelm Leibniz |

| 1709 | Rechenmaschine | Holzkonstruktion | Giovanni Poleni |

| 1727 | Rechenmaschine | Sprossenräder | Antonius Braun |

| 1727 | Rechenmaschine | Stellsegmente | Jacob Leupold |

| 1728 | Webstuhl-Steuerung | gelochte Holzbrettchen | anonym |

| 1770 | Rechenmaschine | konzentrische Zahnräder, Staffelwalzen | Philip Matthäus Hahn |

| 1820 | Rechenmaschine „Arithmomètre“ | (ab 1850 in Serienproduktion) | Charles Xavier Thomas |

| 1850 | Rechenmaschine | Sprossenräder | Willgodt Theophil Odhner |

| 1935 | IBM 601 | lochkartenprogrammier/shy;bare Rechenmaschine | |

| 1941 | Z3 | Computer mit elektronischen Relais | Konrad Zuse |

| 1946 | Eniac | elektronischer Digitalcomputer | |

| 1952 | „ES“ (deutscher Elektronenrechner) | Röhren, Dateneingabe via Lochkarten | |

| 1970 | Sharp QT-8B, Sanyo ICC 82-D | Akkubetriebene Rechenmaschinen |

In der ersten Hälfte des 20. Jahrhunderts fallen mehrere Entwicklungen zusammen. Ein Computer ist dadurch gekennzeichnet, dass er erstens mathematische Operationen ausführen kann (wobei letztlich alle auf Addition zurückgeführt werden) und dass er zweitens gesteuert werden kann. Mit den Rechenmaschinen waren die Grundlagen für abstrakte mathematische Operationen gelegt. Doch für die Steuerung – also die „Programmierbarkeit“, bei bestimmten Bedingungen etwas auszuführen oder eben nicht – gibt es eine andere Entwicklungslinie. Diese beginnt bei Webstühlen.

Joseph-Marie Jacquard (1752–1834) verbesserte die Verfahren, um Webstühle zu steuern. Er ersetzte die Nockenwalze der österreichischen Webstühle durch das Endlosprinzip der Lochkartensteuerung. Verwendete man andere Lochkarten, stellte der Webstuhl ein anderes Muster her. Die Automatisierung begann und führte durch die Verbreitung der Dampfmaschine zu dem Phänomen, das als Industrialisierung bekannt ist.

Die Industrialisierung veränderte das Verständnis von Arbeit. Menschen fielen vereinfacht gesagt in eine von vier Kategorien.

- Sie arbeiteten billig, waren also günstiger als der Einsatz von Maschinen.

- Sie warteten Maschinen, kümmerten sich um einen ungestörten, effektiven Produktionsablauf.

- Sie entwickelten oder programmierten die Maschinen und machten sich nicht in der Produktion die Hände schmutzig.

- Als vierte Option besitzen sie Maschinen, die für sie arbeiten – unter Zuhilfenahme der anderen drei „Menschentypen“.

Arbeit und Produkte waren somit nicht mehr individuell geprägt. Durch die Fokussierung auf Maschinen, war grundsätzlich jede menschliche Position in der Produktion austauschbar. Der Firmenname trat in der Außenwirkung an die Stelle des individuellen Namenszugs. Somit gewann das Firmenimage an Bedeutung und wirkte direkt auf die Marktstellung.

In der heutigen Welt ist diese Aufgabenverteilung der Menschen weiterhin vorhanden. Bei der Hardware-Herstellung ist die Aufteilung offensichtlich. Bei der Nutzung von Computern tritt sie nicht so deutlich in den Vordergrund.

- Ein Unternehmen kann Daten entweder maschinell erfassen oder von Menschen eingeben lassen.

- Eine IT- oder EDV-Abteilung oder ein Dienstleister kümmern sich um das ordnungsgemäße Funktionieren.

- Programmierer oder Software-Firmen erstellen die Software, damit die Aufgaben erfüllt werden können.

- Ein Firmenchef kauft Software oder lässt sie entwickeln, diese wird auf den Computern installiert, damit dann die Daten erfasst und verarbeitet werden können.

Werden Computer verwendet, um andere Produkte zu entwickeln, ist von den Arbeitsdrohnen (1) nicht nur stupide Dateneingabe nötig, sondern ein kreativer Umgang mit der bereitgestellten Software. Aus neutraler Computersicht bleiben sie trotz aller individuellen Befähigung und Kreativität letztlich Arbeitsdrohnen.

Als prominente Namen der ersten Jahrhunderhälfte müssen Konrad Zuse und John von Neumann sowie Alan Turing gelten. Konrad Zuse entwickelte in den 1930er Jahren einen mechanischen frei programmierbaren Computer. John von Neumann legte die theoretischen Grundlagen (1945, „First Draft of a Report on the EDVAC“), nach denen Computer auch heute noch aufgebaut sind. Zu verarbeitende Daten und der Programmcode liegen ↑ binär im Speicher des Computers vor. Das Programm ist somit veränderbar und kann die Daten verändern. Das Programm wird Schritt für Schritt (seriell) abgearbeitet; es kann durch Verzweigungen oder Schleifen aber eine gewisse Komplexität erreichen. Ein Computer benötigt demnach drei Einheiten: zum Speichern der Daten- und Programm-Bits (Computerspeicher), zum Verarbeiten der Bits (arithmetische oder Recheneinheit) und eine Einheit, die die Vorgänge steuert. Dazu kommen Einheiten für Datenein- und -ausgabe. Zuse hatte diese Prinzipien in seiner Maschine verwirklicht, erkannte aber von Neumanns theoretische Leistungen an.

Daneben ist Alan Turing ein theoretischer Vater des modernen Computers. Mit seinen Schriften schuf er die Grundlagen für die moderne Technologie. Insbesondere die sogenannte Turingmaschine gehört zum Basiswissen für Informatiker. Diese kann mit nur drei Operationen (Daten auslesen, Daten schreiben, Schreib-Lese-Kopf bewegen), die seriell auf ein Datenband anhand einer gegebenen Programmierung angewendet werden, alle Probleme lösen, die auch ein Computer lösen kann. Damit lassen sich sämtliche mathematischen Grundfunktionen simulieren. Den Computern liegt das gleiche Verständnis zugrunde: Sämtliche Aktionen werden in kleinere Aktionen zerlegt, solange bis nur noch eine simple Addition von zwei Werten übrig bleibt. Verschiedene Rechnerarchitekturen unterscheiden sich darin, wie gut und effizient sie komplexe Anweisungen in diese Basis-Aktion zerlegen können.

Dazu gibt es zwei grundsätzlich unterschiedliche Ansätze. Intel-Prozessoren verarbeiten möglichst lange Befehle. Es gibt sehr viele verschiedene Befehle, die jeweils mit Parametern und Daten versehen sind. Diese zerlegt der Computer dann in die Basis-Operationen. Im Gegensatz dazu arbeiten beispielsweise ↑ ARM-Prozessoren nach dem ↑ RISC-Prinzip (Reduced Instruction Set Computing). Hier gibt es weniger Befehle, und diese können mit ihren Parametern nur einen Bruchteil der Länge eines „Complex Instruction Set Computing“-Prozessor-Befehls erreichen. Bereits bei der Programmierung wird jedes Problem in möglichst viele Einzelschritte zerlegt. Das ist bei ↑ CISC kaum nötig, da für die meisten Aktionen auch der passende Befehl zur Verfügung steht. Doch aufgrund der Länge und teilweise komplexen Zerlegung von CISC-Befehlen benötigt ein Prozessor mehr Taktzyklen, diesen erst zu zerlegen und dann abzuarbeiten. RISC gilt daher als das elegantere Verfahren, das Daten auch oft schneller verarbeitet.

Allerdings ist der Wettkampf zwischen „reduzierten“ und „komplexen“ Befehlssätzen für Prozessoren zugunsten von CISC entschieden. Computer arbeiten inzwischen genügend schnell, sodass die langsamere Verarbeitung der längeren Befehle im Alltag irrelevant geworden ist. Seit Intels „Pentium“-Prozessoren zerlegen die Prozessoren ihre Befehle nicht mehr selbst, sondern es ist eine Prozessoreinheit vorgeschaltet, die die CISC-Befehle in RISC-Anweisungen aufbereitet. Die eigentliche Ausführung erledigt dann ein RISC-Prozessor, was die Bearbeitung beschleunigt.

In Embedded Computern und Mobilgeräten wie Telefonen oder PDAs werden dennoch oft ARM-Prozessoren verbaut – denn in diesem Bereich ist jedes Quentchen Geschwindigkeit nötig. ARM-Prozessoren arbeiten zumeist effizienter als CISC-Prozessoren, da sie keine zusätzliche Komponente für das Befehlszerlegen benötigen, die zusätzliche Energie verbraucht.

Parallel zu Zuses programmierbarer Rechenmaschine entstanden in den USA elektronische Rechenmaschinen, als erster wichtiger Vertreter die IBM 601. Konrad Zuses Z3 arbeitete mit elektronischen Relais und war „turingmächtig“, damit gilt sie als erster voll funktionstüchtiger Computer. Der Eniac ist der erste elektronische digitale Universalrechner in den USA. Auch zahlreiche analoge Rechner entstanden, die vorwiegend für Spezialaufgaben wie physikalische Problemstellungen eingesetzt wurden.

In den 1960er und 70er Jahren breiteten sich Großrechner aus. IBM entwickelte mehrere Rechner, die denselben Code ausführen konnten, während sonst die Programme für jeden Computer neu erstellt werden mussten. Das Betriebssystem lieferten die Computerhersteller mit. Programme wurden jeweils für den Einzelfall erstellt. Eine Software-Industrie im heutigen Sinne gab es nicht.

Als Texas Instruments 1964 den integrierten Schaltkreis (integrated circuit, IC) entwickelte, erlaubte das langfristig kleinere, schnellere und billigere Computer. 1971 baute Intel den ersten Mikroprozessor mit 2.250 Transistoren. Intel-Mitgründer Gordon Moore formulierte 1965 die Prognose, dass sich die Komplexität der Prozessoren alle zwei Jahre verdoppelt, bei gleichbleibenden Kosten. Heute lebt diese Prognose als „Moore’s Law“ weiter und besagt – nach einer Korrektur von Moore selbst –, dass die Anzahl der Transistoren auf einem Chip sich etwa alle 18 Monate verdoppelt. Für das gleiche Geld bekäme man also 18 Monate später einen doppelt so leistungsfähigen Chip, wobei Leistungsfähigkeit nicht nur die messbare Geschwindigkeit eines Computers bezeichnet. Die Kosten für die Hardware sanken bei gleichzeitiger Steigerung der Leistung. Bald ließen sich die Kosten für die Software-Erstellung nicht mehr in den hohen Hardwarekosten „verstecken“, und erste Softwarefirmen entstanden.

Ab Mitte der 1970er Jahre gab es erste „Personal Computer“ zu kaufen, bis dahin arbeitete man via Terminal an einem Großrechner. Der PC bedeutete die Individualisierung der Computernutzung im Klima der Nach-Hippie-Bewegung. Zunächst waren PCs nur Bastelsätze, deren Leistungsfähigkeit heutige programmierbare Taschenrechnern leicht übertreffen. Nach ihrem ersten Computer 1976 brachte Apple 1977 den erfolgreichen Apple ][ auf den Markt. Diese Rechner waren keine Bausätze mehr, sondern wurden als fertig zusammengebaute Computer angeboten.

Die Einstellung gegenüber Computern änderte sich mit persönlichen Computern grundlegend. Bis dahin war es Privilegierten vorbehalten, einen Großrechner für sich arbeiten zu lassen. Die Rechenzeit wurde zugewiesen. Der PC stand hingegen im Wirkungs- und Machtbereich einer Einzelperson. Nach der großen Zentralrechner-Ära folgte nun die dezentrale Ära. Mit der Etablierung von Netzwerkdiensten fügten sich diese PCs später wieder in einen großen Rechnerverbund.

1975 gründeten Bill Gates und Paul Allen die Firma Microsoft, die Programme für andere Computer entwickelte. Sie schlossen mit dem Hersteller des Altair-Computers einen Vertrag, wodurch mit jedem Altair ihre Programmiersprache Basic verkauft wurde. Der Vertrag gestattete es Microsoft, ihr Basic auch anderen Herstellern zu verkaufen. Apple und Commodore lizensierten Basic und entwickelten es weiter, ebenso erstellten andere Firmen Basic-Versionen, sodass es diese Programmiersprache für alle Computerplattformen gab. Selbst auf den DDR-Computern KC85 und KC87 lief Basic.

Einen vergleichbaren Deal schloss Microsoft 1981 mit IBM, das ein Betriebssystem für seinen neuen PC brauchte, nachdem entschieden worden war, nicht mehr nur Großrechner anzubieten. Microsoft konnte IBM überzeugen, die Hardware-Spezifikationen zu veröffentlichen, sodass andere Hersteller gleichartige Computer herstellen konnten. Auf allen IBM-PCs lief Microsofts Disk Operating System (DOS) – und auf allen kompatiblen Rechnern ebenfalls. Damit war eine einheitliche Computerlandschaft entstanden. Und alle diese Computer basierten auf Microsofts DOS, das hastig aus QDOS (einem CP/M-Nachbau, das inoffiziell „Quick and Dirty Operating System“ hieß) entwickelt worden war.

Neben den IBM- und kompatiblen PC für „ernsthafte“ Nutzer, gab es in den 1980ern eine breite Palette verschiedener Computer. Der populärste war der Commodore 64, der 1982 erschien. 1987 folgte der Amiga. Von 1985 bis 1994 bot Atari seine ST-Rechner an. 1984 erschien Apples Macintosh, der erste kommerziell erfolgreiche Computer, der eine grafische Benutzeroberfläche bot. Die „GUI-Erfinder-Firma“ Xerox scheiterte am Markt mit ihrem Star-Computer. Daneben gab es noch zahlreiche weitere Computersysteme, beispielsweise Osborne, Tandy oder Spielkonsolen.

Die Computerlandschaft erforderte, dass Programme für jede Plattform neu geschrieben werden mussten, auch der Austausch von Dateien war nicht ohne weiteres möglich. Die heterogene Computerwelt war noch weit davon entfernt, durch bestimmte Hardware-Komponenten (heute Intel-Prozessoren), Betriebssysteme (heute Windows) oder Spezialprogramme (heute Adobe Photoshop im Bereich Bildbearbeitung oder MS Word im Bereich Textverarbeitung) monokulturelle Tendenzen erkennen zu lassen. Keine Lösung erreichte die Marktführerschaft, sondern fand sich stets umgeben von Konkurrenten. Zumal viele Lösungen für Unternehmen je nach Einsatzzweck neu zusammengestellt, angepasst oder entwickelt wurden: Hardware, Vernetzung und Software.

1991 „erfand“ Tim Berners-Lee das World-Wide-Web als Teil des Internet, indem er verschiedene bestehende Ideen zu einer großen Idee verband. Computer waren zwar vorher schon vernetzt, doch es gab für jede Aufgabe einen oder mehrere Standards: für eMail, Datentransfer, Fernwartung bzw. Computerbedienung aus der Ferne. Die Vernetzung innerhalb von Büros, wo sich beispielsweise mehrere Computer einen Datei-Server oder einen Drucker teilten, war nichts Besonderes. Das Internet war ein Sammelbegriff für alle Möglichkeiten, Daten zwischen verschiedenen lokalen Netzwerken auszutauschen. Neben dem theoretischen Aufbau des World Wide Web entwickelte Berners-Lee die Hypertext-Markup-Language, die die Basis für Internetseiten bildet.

Auf einem Next-Computer richtete er den ersten Web-Server ein und programmierte den ersten Web-Browser. Er formulierte vier Basis-Aufgaben für das World-Wide-Web: Das Internet soll genauso einfach zu bearbeiten sein wie zu erkunden. Computer können Aufgaben im Hintergrund erledigen. Eine Netzstruktur ist besser als eine Baumstruktur, einzige Ausnahme bildet der hierarchische Aufbau der Domain-Namen. Informatiker tragen nicht nur technische, sondern auch moralische Verantwortung. Diese vier Ansprüche gehen in der heutigen Internetrealität oft verloren.

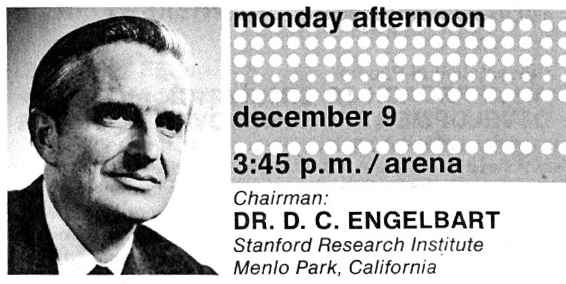

Abgesehen von der technischen Entwicklung auf der Hardware-Seite hat sich auch die Bedienung des Computers grundlegend über die Jahrzehnte verändert. Das einschneidendste Ereignis fand im Bereich der Software statt: Douglas Carl Engelbarts „Mutter aller Demos“. Er präsentierte 1968 die Grundlagen, die für uns heute selbstverständlich sind, damals aber so sehr nach Utopie aussahen, dass es mehrere Jahrzehnte dauerte, bis sie alle umgesetzt wurden.

Die Ankündigung für Engelbarts Demonstration (1968), aus der sich unsere heutige Computerbedienung entwickelte. [Abbildung: http://sloan.stanford.edu/MouseSite/1968Demo.html]

Engelbart demonstrierte unter anderem ein optisches Zeigegerät, das sich in den 1980ern zu der uns bekannten Maus weiterentwickelte. Er war damit in der Lage, den Textcursor frei zu platzieren, Text zu markieren, auszuschneiden und an anderer Stelle einzufügen (↑ Cut \& Paste). Er zeigte die Arbeit an miteinander vernetzten Computern und führte einen Online-Chat mit integriertem Video. Die Computersteuerung verfügte sogar über eine kontextabhängige Hilfefunktion.

Der Datenraum, den Engelbart nicht nur schuf, sondern auch direkt manipulierbar machte, war der erste kurze Blick in die Zukunft, in der wir fünf Jahrzehnte später leben. Steven Johnson betont die Bedeutung von Engelbarts Demonstration in seiner „Interface Culture“:

Not since the RenaissanceÜbertragung: Seit die Renaissance-Künstler die mathematischen Grundlagen für gezeichnete Perspektive entdeckten, hat keine Technologie die räumliche Vorstellung so dramatisch verändert. … Das Industriezeitalter gab uns Prothesenglieder und Mensch-Maschine-Hybriden, aber Doug Engelbart gab uns die erste Maschine, in der man leben möchte. artisans hit upon the mathematics of painted perspective has technology so dramatically transformed the spatial imagination. […] The industrial age gave us our prosthetic limbs and man-torpedo hybrids, but Doug Engelbart gave us the first machine worth living in.

Der Datenraum, der Cyberspace, war eine Abkehr von herkömmlichen Maschinen. Denn bislang sollten Maschinen nur menschliche Defizite ausgleichen: Kräne sind stärker und höher als Männer, Webstühle arbeiten schneller und gleichmäßiger als Frauenhände, Karren und Eisenbahnen transportieren mehr und schneller als Menschen. Doch nun war am Computer etwas entstanden, das eben nicht Defizite ausglich, sondern dazu einlud, sich in eine neue Sphäre zu begeben. Der Mauszeiger bildete die verlängerte Hand des Nutzers, der damit in dieser erweiterten Welt („augmented reality“) agierte, die nur mittelbar – über elektrische Signale – mit der Welt des Nutzers verbunden war.

Filme wie „Das Netz“ (1995), „Hackers“ (1995) oder „Matrix“ (1999) arbeiten bewusst damit, dass diese zwei Welten, die reale Welt der Nutzer und die virtuelle Datenwelt, miteinander verbunden sind und einander direkt beeinflussen. Dazu schaffen sie gegenseitige Abhängigkeiten, die missbraucht werden. „Tron“ (1981) dagegen trennt optisch und auf der Handlungsebene sehr genau zwischen diesen zwei Welten, die nur via Datenein- und -ausgabe aufeinander wirken können.Mehr über „Computer im Kino“ im gleichnamigen Buch.

In den 1970ern wurden viele dieser Visionen experimentelle Wirklichkeit. Der Kopiererhersteller Xerox richtete das Palo Alto Research Center (PARC) ein. Dort entstand eine funktionierende grafische Benutzeroberfläche, die mit einer Maus zu bedienen war. Der erste „What you see is what you get“-Texteditor namens Bravo bewies die Fähigkeit und Nützlichkeit des Systems. Netzwerkprotokolle (TCP/IP) und -technik (Ethernet) entstanden ebenfalls im Parc. Auch der erste Laserdrucker wurde dort in Betrieb genommen. Für Nutzer weniger relevant war die Entwicklung der objektorientierten Programmierung; diese war jedoch von einschneidender Bedeutung, da sie die heutige Software und deren Bedienung erst ermöglichte. Der Vorläufer von PostScript (eine Druckerbeschreibungssprache), die sich in PDF weiterentwickelte, wurde ebenfalls dort entwickelt. Nicht zuletzt schuf Alan Kay mit seinem Dynabook den Urahn aller Laptops.

Außer dem Laserdrucker verstand es Xerox nicht, die Forschungsergebnisse gewinnbringend zu nutzen. Einige ehemalige Parc-Forscher gründeten später ihre eigenen Unternehmen. So war Robert Metcalfe mit 3com erfolgreich im Bereich von Netzwerklösungen, und John Warnock gründete Adobe, um InterPress (dann in PostScript umbenannt) zu vermarkten. Andere wechselten in die universitäre Forschung oder kamen bei Microsoft unter, beispielsweise entwickelte der Bravo-Mitprogrammierer Charles Simonyi dann „Microsoft Word“ und gründete 1991 das Microsoft Research Center. 2002 gründete Simonyi sein eigenes Unternehmen, um sein Konzept der Intentionalen Programmierung zu verwirklichen. Die GUI-Forschungen im PARC bildeten später die Ausgangsbasis für den Macintosh und Windows.

| Hardware | Software | Vernetzung | |

|---|---|---|---|

| 1930er | erste funktionierende Computer | „Lochkarten“ | — |

| 1960er | Großrechner | für jeden Rechner anders | Terminals |

| 1970er | erste PCs | Basic als allgemeine Programmiersprache, Kommandozeile (CP/M, Unix) als einheitliche Oberfläche | — |

| 1980er | PCs und Heimrechner | DOS Quasi-Standard, erste GUIs (Mac) | vorwiegend innerhalb von Büros |

| 1990er | PCs und Laptops | Windows Quasi-Standard | Internet entwickelt |

| 2000er | PCs, Laptops, sonstige Geräte | Windows Quasi-Standard; MacOS X; Linux | Internetzugang ist Standard |

Die Speicheranbindung kennzeichnet die bisher fünf Stufen der Computerentwicklung. Intels erster Mikroprozessor besaß eine Speicheranbindung von 4 bit (↑), konnte also 24 AdresszellenDie Zwei gibt die Anzahl der verschiedenen Zustände an (0 und 1), die Vier die Anzahl der Stellen. Im Dezimalsystem ist das für uns einleuchtend: Mit vier Stellen lassen sich 1.000 Zustände ausdrücken: 104, zehn verschiedene Ziffern (0 bis 9) und vier Stellen. Hier gibts das noch mal ausführlich. oder ein halbes Byte auf einmal bearbeiten. Der erste Apple-Computer und der C 64 waren 8-bittig, konnten also 256 Adresszellen ansprechen (28) bzw. ein Byte während eines Taktzyklus abarbeiten. Ab Mitte der 1980er Jahre wurde mit dem Intel-Prozessor 80286 (kurz 286 genannt) 16 bit zum Standard. Der erste Mac war bereits ein 16/32-bit-Computer, der Prozessor arbeitete intern mit 32 bit. Der Amiga war ebenfalls eine hybride 16/32-bit-Maschine und wuchs sich bald zu einer reinen 32-bit-Maschine aus. Wie beim Mac lagen Programme zwar häufig in 16 bit vor, doch auf 32 bit optimierte Programme konnten die Hardware noch besser ausnutzen. Vereinfacht gesagt, wurden Programme in einer Programmiersprache geschrieben und dann in Computercode „übersetzt“ (assembliert). Je nach Übersetzung lag der assemblierte Code dann als 16- oder 32-bit-Version vor.

Die Festlegung auf acht bit als Standardbreite für ein Datenwort erwuchs historisch aus den Vielfachen von Zwei. Die Bittigkeit der Prozessoren wurde kontinuierlich verdoppelt, sodass die Computer immer mehr Daten auf einmal abarbeiten konnten, bei 32 bit eben vier Byte, durch die Steigerung der Prozessorgeschwindigkeit und die Nutzung mehrerer paralleler Prozessoren können so in einer Sekunde mehrere Millionen Byte abgearbeitet werden. Passend zum ersten verbreiteten Standard (8-bit-Prozessoren) umfasst der erweiterte ↑ ASCII-Code, in dem Computercode und Texte gespeichert sind, 256 Zeichen ($2^8$). Die technische Erfordernis und der benötigte Zeichenvorrat setzten somit 8-Bittigkeit als Basis.

Mit der Umstellung auf PowerPC-Prozessoren Anfang der 1990er wurde 32 bit zum Standard auf Macs. Alte 16-bit-Programme wurden vom System quasi live in 32 bit übersetzt und ausgeführt, manche liefen dadurch langsamer, was die insgesamt schnelleren Systeme meist ausglichen. Für den Nutzer verlief der Umstieg von 16 auf 32 bit ohne Komplikationen, denn das System kümmerte sich um die Arbeit, und Programme mussten nicht in einer neuen Version vorliegen, nur um sie auf einem neuen Computer zu benutzen. Einen solchen hürdenfreien Umstieg lieferte Apple mit dem Wechsel auf MacOS X erneut, als das klassische System in das neue integriert wurde, sodass alte Programme weiterhin genutzt werden konnten. Programme, die für die modernisierte Carbon-Programmierschnittstelle angepasst waren, liefen sogar gleichermaßen auf dem klassischen und modernen System.

Der Umstieg auf Intel-Prozessoren ab 2006 war für die Nutzer ebenfalls nahtlos. Programme für die alten Mac-Prozessoren (G3, G4) wurden live in Intel-Prozessorcode übersetzt und konnten somit problemlos weiterverwendet werden. Diesen Systembestandteil betonte Apple in seinem Marketing nie sonderlich; es gehört zur Philosophie, dass technische Hintergründe nicht ausführlich präsentiert und herausgestellt werden – lassen sie sich mit einem für Nutzer erkennbaren Mehrwert verbinden, werden sie als Feature aufgeführt. Die Live-Übersetzung von altem Code für Intel-Prozessoren nannte Apple „Rosetta“, in Anlehnung an den Stein von Rosetta (186 v.u.Z.)

Mit der Umstellung auf G5-Prozessoren (2003), die aufgrund ihrer Wärmeentwicklung nur in PowerMacs eingesetzt und ab 2006 zugunsten von Intel-Prozessoren aufgegeben wurden, fand ein weiterer Wechsel hinter den Kulissen statt: von 32 auf 64 bit. Dieser Wechsel ist jedoch vorwiegend für Entwickler relevant, die Nutzer spürten davon nichts. Ein aktueller Mac kann drei Arten von Computercode gleichzeitig bewältigen: Programme für die alten PowerPC-Prozessoren, für 32 und 64 bit. Bei Windows dagegen muss derzeit bei der Installation zwischen 32 und 64 bit gewählt werden, Programme und Gerätetreiber müssen dann auch jeweils in der korrekten „Bittigkeit“ vorliegen.

Der Intel 80386 markierte 1985 den generellen Wechsel zu 32 bit. War die Software darauf abgestimmt, war auch ein Geschwindigkeitszuwachs spürbar. Windows 95 war aufgrund seiner DOS-Wurzeln noch größtenteils 16-bittig, konnte aber auch 32-bit-Anwendungen starten. Für die Nutzer war es unerheblich, ob ein Programm in 16 oder 32 bit vorlag, da die 32-bit-Prozessoren abwärtskompatibel waren.

Möglicherweise wird von künftigen Computerhistorikern die Geschichte anders eingeteilt, nämlich nach Anzahl der Prozessorenkerne. Dann gäbe es eine Phase der Ein-Prozessor-Maschinen und ab etwa 2007 eine der Mehr-Prozessor-Maschinen. Intel schuf mit dem „Core Duo“ einen Prozessor für den Massenmarkt, der mehrere Prozessorkerne beinhaltet, die sich die Aufgaben teilen, sodass bei zwei Kernen theoretisch doppelt so viele Operationen in der selben Zeit abgearbeitet werden. Bei geschickter Programmierung ist das System damit nicht nur schneller, sondern auch zuverlässiger.

Mit der Etablierung von Mehrkernprozessoren ist die Geschwindigkeit des Prozessors nicht mehr alleiniges Marketing-Kriterium für die Geschwindigkeit, sondern auch die Anzahl der Kerne und die Effizienz der Aufgabenverteilung spielen eine wichtige Rolle. Die Software muss wie bei dem Wechsel von 8 auf 16, 32 und 64 bit auf die neue Hardware angepasst werden, damit der Geschwindigkeitsvorteil auch beim Nutzer ankommt. Nicht angepasste Programme können nur einen einzelnen Prozessorkern nutzen, während angepasste ihre Aufgaben auch von mehreren gleichzeitig bearbeiten lassen können. Das Betriebssystem verteilt die Programme und eigenen Aufgaben auf die Prozessorkerne.

Mit „Grand Central“ hat Apple 2009 eine Programmierhilfe geschaffen, um Programme für Mehrkernprozessoren zu optimieren. Dabei werden im Programmcode die Abschnitte gekennzeichnet, die als eigenständiger Prozess laufen können. MacOS X übernimmt das Management dieser entstehenden Prozesse und verteilt sie auf die vorhandenen Kerne. Davon profitieren nicht nur einzelne Programme, sondern das gesamte Betriebssystem, da sich viele kleine Prozesse gleichmäßiger verteilen lassen als wenige große. So können einzelne Prozesse das System schlechter ausbremsen, und für den Nutzer fühlt sich der Computer flotter an.

Die folgenden Kapitel werden weniger die technische Entwicklung chronologisch darstellen als vielmehr Verbindungen und Abhängigkeiten aufzeigen sowie die kulturellen und sozialen Kontexte beleuchten. Meine Betrachtungen steigen gegen Ende der 1970er Jahre ein und vernachlässigen die Zeit davor weitgehend. Denn ab Ende der 1970er Jahre hatten Computer ihren Exotenstatus zunehmend verloren, und es war vielen Menschen möglich, erste Erfahrungen mit ihnen zu sammeln. Auch wurde die Firma, die im Zentrum stehen soll, 1976 gegründet.

Überblick über „Der Apple-Faktor, Band I“:

1. Einleitung

2. Die Anfänge

3. Von der Taste zum Touch

4. Von der Anweisung zum Klick

5. Virtueller Schreibtisch

6. Vom Buchstaben zur Transparenz

7. Vom Einzelplatz zum Netz

8. Von der Philosophie zum Kompromiss

9. Die wunderbare Welt der Software

10. Zum Ende: Versuch eines Vergleichs zwischen Mac OS X und Windows Sieben

Epilog: Eine neue Zeit

![Nachbau der Leibniz-Rechenmaschine und eine mechanische Rechenma- schine von . [Abbildungen: Wikipedia] Nachbau der Leibniz-Rechenmaschine und eine mechanische Rechenma- schine von . [Abbildungen: Wikipedia]](https://www.zanjero.de/wp-content/uploads/2012/06/leibniz_mech-600x173.png)

ein Kind der 70er • studierter Anglist/Amerikanist und Mediävist (M.A.) • wohnhaft in Berlin • Betreiber dieses Blogs zanjero.de • mehr über Alexanders Schaffen: www.axin.de ||

ein Kind der 70er • studierter Anglist/Amerikanist und Mediävist (M.A.) • wohnhaft in Berlin • Betreiber dieses Blogs zanjero.de • mehr über Alexanders Schaffen: www.axin.de ||

Pingback: Der Apple-Faktor: Einleitung | zanjero.de

Pingback: Der Apple-Faktor, Band I | zanjero.de

Pingback: Der Apple-Faktor: Zum Ende | zanjero.de

Pingback: Der Apple-Faktor: Vom Einzelplatz zum Netz | zanjero.de

Pingback: Der Apple-Faktor: Epilog – Eine neue Zeit | zanjero.de

Pingback: Der Apple-Faktor: Die wunderbare Welt der Software | zanjero.de

Pingback: Der Apple-Faktor: Vom Buchstaben zur Transparenz | zanjero.de

Pingback: Der Apple-Faktor: Virtueller Schreibtisch | zanjero.de

Pingback: Der Apple-Faktor: Von der Anweisung zum Klick | zanjero.de

Pingback: Der Apple-Faktor: Von der Taste zum Touch | zanjero.de